In un’epoca in cui l’intelligenza artificiale non è più un concetto futuristico ma una risorsa concreta, saperla integrare nei processi creativi rappresenta la nuova frontiera competitiva per chi opera nel mondo del web design e del marketing digitale. Non si tratta solo di adottare strumenti tecnologici, ma di trasformare il modo in cui si progettano esperienze, si costruiscono funnel e si generano contenuti ad alto impatto visivo e comunicativo.

Il cuore pulsante di questa evoluzione è proprio la capacità dell’intelligenza artificiale di generare contenuti digitali – testi, immagini, video, audio – attraverso modelli sempre più sofisticati. L’obiettivo non è sostituire l’umano, ma amplificarne le potenzialità creative, velocizzare i cicli produttivi e portare alla luce nuove forme di narrazione visuale. Per designer, sviluppatori e marketer, significa poter contare su strumenti generativi che si adattano ai contesti, comprendono gli intenti e producono asset pronti per l’uso.

In questo articolo esploreremo come sfruttare l’intelligenza artificiale nei flussi di lavoro creativi, analizzando le dinamiche che legano l’automazione alla produttività, l’elaborazione neurale alla coerenza semantica, e la sintesi multimodale alla performance comunicativa. Non ci limiteremo a elencare tool, ma andremo a fondo nella logica che sta alla base dei generative agents, dei prompt multimodali e dei processi di creazione ibrida uomo-macchina.

Capiremo come il design generativo possa influenzare l’esperienza utente, come un’interfaccia intelligente possa guidare l’interazione e come l’AI possa fungere da vero agente digitale operativo. Analizzeremo le opportunità offerte da strumenti capaci di apprendere dai dati contestuali e restituire risultati in linea con obiettivi editoriali, UX e conversione.

Che tu sia un consulente SEO, un art director, uno sviluppatore WordPress o un content strategist, questo è il momento di acquisire un nuovo paradigma operativo, dove creatività e intelligenza artificiale non si escludono, ma si potenziano.

Cos’è l’AI multimodale e come cambierà web e marketing

L’AI multimodale rappresenta molto più di una semplice evoluzione dell’intelligenza artificiale: è un cambio totale di prospettiva nel modo in cui i contenuti vengono generati, distribuiti e vissuti. Tradizionalmente, i sistemi di AI erano specializzati in una singola modalità: testo, immagine o voce. Oggi, invece, i modelli multimodali sono in grado di processare input diversi — come descrizioni testuali, fotografie, comandi vocali o video — e generare output coerenti e coordinati, creando esperienze unificate e interattive.

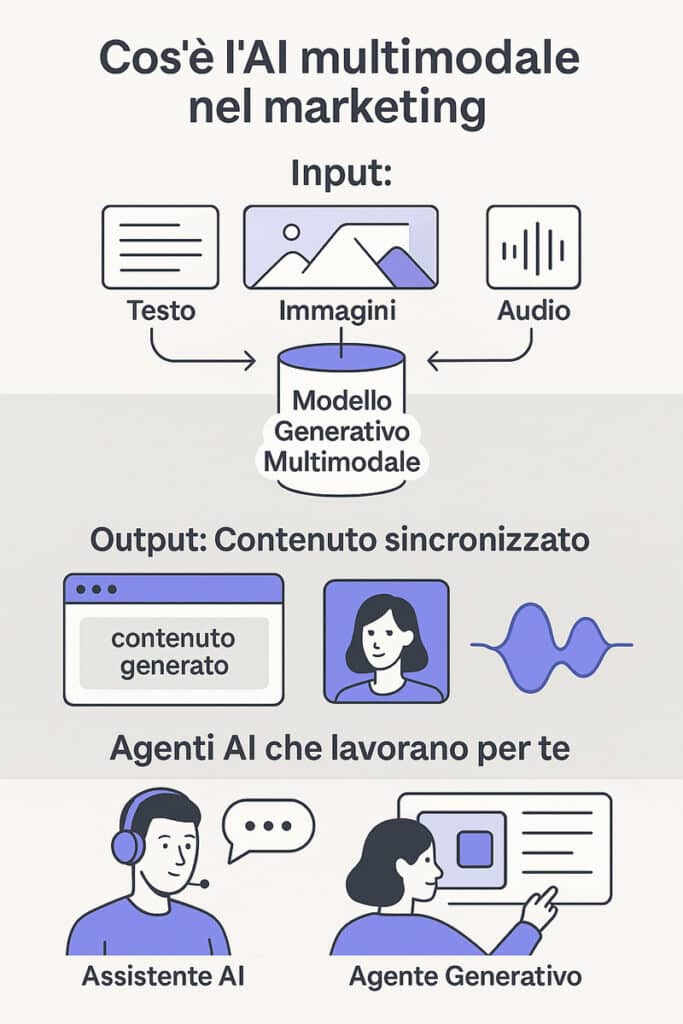

Ecco una rappresentazione visiva che mostra in sintesi il funzionamento dell’AI multimodale applicata al digital marketing.

Questa trasformazione ha implicazioni profonde per il mondo del web design e del marketing digitale. Pensiamo, ad esempio, alla progettazione di una pagina prodotto: un input testuale può generare in automatico un mockup visivo, una narrazione audio con tono coerente al brand, un video dimostrativo adattato al target e una CTA visiva localizzata. Tutto ciò avviene senza frammentare il flusso di produzione, con un livello di coerenza comunicativa che sarebbe impossibile ottenere manualmente senza un team multidisciplinare.

Alla base di questa tecnologia troviamo un insieme di modelli di sintesi avanzata: sistemi come Gemini, GPT‑4o e Claude 3 combinano machine learning supervisionato, natural language processing e architetture neurali capaci di adattarsi al contesto. Non si tratta più di AI che risponde passivamente a una richiesta, ma di entità intelligenti in grado di comprendere lo scopo dell’interazione, generando contenuti ottimizzati per diversi canali — visivo, testuale, sonoro — in un unico ciclo creativo.

Per chi lavora nel settore creativo e strategico, l’introduzione di questa AI ibrida e contestuale consente di realizzare interfacce dinamiche e responsive, sfruttando input multipli per creare esperienze sinergiche. L’output non è più statico o predefinito, ma costruito su misura, in tempo reale e in funzione dell’obiettivo comunicativo. La differenza rispetto alla produzione tradizionale è radicale: non si tratta più di adattare il contenuto al canale, ma di lasciare che il canale nasca già integrato nel contenuto.

Questa rivoluzione operativa non è riservata ai grandi brand. È accessibile a chiunque sappia comprendere il funzionamento dei nuovi modelli e integrarli nei propri workflow: dai designer freelance ai consulenti SEO, dagli sviluppatori alle agenzie. L’AI multimodale non è una moda: è la nuova grammatica del digitale.

Comprendere la multimodalità: testi, immagini, video, audio

Quando parliamo di contenuti multimodali, ci riferiamo a un paradigma comunicativo dove il significato non viene espresso attraverso un solo canale (come il testo), ma tramite una simbiosi tra elementi visivi, sonori e narrativi. L’intelligenza artificiale oggi è in grado di ricevere un input — ad esempio un prompt testuale — e generare da esso un video coerente, un’immagine descrittiva, una colonna sonora, un voiceover personalizzato, e persino una struttura HTML pronta all’uso. Tutto ciò non in sequenza, ma simultaneamente.

Nel web design, questa capacità si traduce in una progettazione liquida, dove i confini tra interfaccia, contenuto e narrazione scompaiono. Un’agenzia può creare in tempo reale landing page dinamiche, con elementi visuali generati da immagini stock adattate al tono del brand, testi ottimizzati per l’intento di ricerca e CTA vocali interattive. Il designer non lavora più come esecutore di componenti separate, ma come orchestratore di flussi creativi multimodali.

Dal punto di vista tecnico, l’efficacia deriva dai modelli encoder-decoder, che comprendono le relazioni semantiche tra linguaggio e media. In particolare, i transformer multimodali permettono di costruire una rappresentazione condivisa del significato, creando output sincronizzati e coerenti tra tutti i canali. Questo è un vantaggio enorme in ottica SEO e UX: la consistenza tra copy, grafica e contenuto audio aumenta il tempo di permanenza, la comprensione e l’engagement.

Infine, l’aspetto più strategico riguarda i prompt cross-mediali: istruzioni strutturate che guidano l’AI a generare asset coordinati su più livelli. Un singolo prompt può diventare la base per una scheda prodotto, una presentazione, una storia Instagram e un audio podcast, mantenendo coerenza narrativa e visuale. È questa la vera forza dell’AI multimodale: creare esperienze unificate, distribuite e ad alto impatto emotivo.

Generative Agents: gli assistenti AI che lavorano per te

I generative agents non sono chatbot evoluti, ma veri e propri assistenti intelligenti autonomi capaci di agire, decidere e ottimizzare processi digitali. A differenza delle intelligenze artificiali reattive — che rispondono a un prompt e si fermano — gli agenti generativi sono progettati per interagire con ambienti, strumenti e altri modelli. Lavorano in background, imparano dall’esperienza, pianificano strategie e generano contenuti in modo dinamico, anche senza l’intervento diretto di un operatore.

Nel marketing digitale e nello sviluppo di siti WordPress o WooCommerce, ciò significa automatizzare task come la generazione di testi personalizzati, la pubblicazione su blog o social, la segmentazione dei funnel e l’adattamento delle interfacce utente in tempo reale. Un agente può osservare come un utente interagisce con una pagina e modificare titolo, CTA, colore del bottone e microcopy per massimizzare l’azione desiderata. Questo approccio non è sperimentale: viene già testato in ambienti reali da startup e agenzie italiane con risultati concreti.

Dal punto di vista architetturale, un generative agent può combinare un modello LLM come GPT‑4o, un planner interno, un memory module e un layer di interazione con strumenti esterni via API o CMS. Questo gli consente di creare flussi editoriali interamente autonomi: dall’ideazione di un articolo alla sua impaginazione e pubblicazione. In contesti aziendali, può essere impiegato per scrivere report, produrre visual, orchestrare email marketing e monitorare metriche senza che l’utente debba interagire con ogni fase.

L’adozione degli agenti generativi richiede un cambio di mentalità: dal micro-management al controllo strategico. Non servono più operatori che gestiscono ogni dettaglio, ma figure che istruiscono e supervisionano le AI operative, delegando i compiti a valore ripetitivo. È in questo spazio che nasce un nuovo ruolo professionale: il direttore d’orchestra algoritmico, capace di far lavorare le intelligenze artificiali come un team multidisciplinare.

Perché integrare AI multimodale e agenti nel workflow creativo

Integrare l’intelligenza artificiale multimodale e i generative agents nei processi creativi non è più un vantaggio sperimentale, ma una necessità operativa. Le aziende, le agenzie e i professionisti che adottano questi strumenti riescono a ridurre i tempi di produzione, aumentare la qualità del risultato e centralizzare l’intera pipeline in un unico flusso sinergico. Si passa da una gestione sequenziale e discontinua a una produzione creativa fluida, dove ideazione, prototipazione e pubblicazione sono coordinate dall’AI.

Ecco una rappresentazione visiva delle fasi, strumenti e interazioni tra AI e supervisione umana all’interno di un workflow creativo integrato.

La vera differenza rispetto agli strumenti tradizionali non è solo la velocità, ma la capacità dell’AI di supportare ogni fase del workflow con modelli predittivi, assistenti contestuali, automazioni intelligenti e logiche di apprendimento continuo. Il copywriter ottiene suggerimenti semanticamente coerenti con lo stile del brand, il designer riceve mockup dinamici adattabili, il social media manager può generare e programmare contenuti da un unico input. In questo modo, si sviluppa una collaborazione uomo-AI reale, non teorica.

Il concetto chiave è quello di design aumentato: l’AI non sostituisce la creatività, ma la amplifica. Suggerisce, corregge, propone alternative. I generative agents diventano colleghi digitali in grado di seguire task multipli, adattarsi ai cambiamenti e migliorare i processi iterativi senza richiedere interventi costanti. Questo permette ai team di liberarsi dalle operazioni ripetitive e concentrarsi sulla strategia, sulla visione, sulla narrazione.

Dal punto di vista organizzativo, il beneficio è duplice: da un lato, si ottimizza il carico cognitivo; dall’altro, si migliora la qualità del risultato finale. I flussi diventano adattivi, i contenuti si rigenerano in tempo reale e l’intero sistema creativo si allinea con le nuove dinamiche del digital marketing, basate su personalizzazione, velocità e precisione semantica. Integrare l’AI nel workflow significa potenziare l’identità del brand e rendere ogni touchpoint parte di un’esperienza coerente.

Vantaggi in fase di ideazione, creazione e pubblicazione

I vantaggi di integrare l’intelligenza artificiale nei flussi creativi emergono con chiarezza in ogni fase: ideazione, creazione e pubblicazione. Durante la fase iniziale, l’AI può generare spunti visivi, costruire moodboard da prompt testuali, proporre naming coerenti con l’identità di marca, o analizzare trend semantici per guidare la direzione editoriale. Questo significa accelerare la fase strategica e ridurre drasticamente il tempo di avvio di un progetto.

Nel momento della creazione, l’interazione uomo-macchina raggiunge il suo apice. Il designer non parte da zero: riceve bozzetti coerenti da refiner visivi. Il copywriter lavora su bozze già ottimizzate per intenti e canali. L’AI supporta con contenuti adattabili, segmentabili, multilingua. Questo approccio moltiplica la capacità produttiva del team, riduce gli errori e aumenta l’accuratezza stilistica e funzionale.

Infine, nella pubblicazione, l’AI si fa esecutore strategico. Schedula i contenuti sui canali corretti, li ottimizza in base al momento di pubblicazione, e ne valuta in tempo reale il rendimento in termini di CTR, engagement e coerenza con la strategia iniziale. Se un contenuto underperforming viene individuato, può essere rigenerato e ripubblicato automaticamente, ottimizzando budget e visibilità. L’intero flusso diventa un ciclo continuo di miglioramento.

Questa struttura genera una pipeline AI-powered, dove il contributo umano diventa direzionale, creativo e strategico. Le macchine si occupano dell’esecuzione, della velocità, della precisione. In questo scenario, il team creativo non viene ridotto, ma elevato a un nuovo livello di efficienza e consapevolezza progettuale.

Dall’UX writing al visual design: l’impatto reale

L’integrazione dell’intelligenza artificiale nell’UX design segna un punto di svolta tangibile. Non si tratta più solo di ottimizzare testi o visuali, ma di generare interfacce dinamiche, personalizzate e predittive. L’AI analizza dati comportamentali in tempo reale, adatta microcopy, CTA e layout in base al contesto d’uso, alla lingua dell’utente, al suo device e persino all’ora del giorno. È una progettazione viva, guidata da logiche neurali.

In una pagina di onboarding, ad esempio, l’intelligenza artificiale può ridurre la complessità linguistica se rileva disorientamento, oppure rafforzare il messaggio se l’utente mostra indecisione. Il copy non è più fisso: si adatta, si espande, si semplifica, cambia tono. Il visual si adegua con immagini coerenti all’intento rilevato. Tutto questo non avviene per regole rigide, ma tramite modelli neurali che apprendono dal comportamento reale.

Il vantaggio? Un’esperienza utente fluida, centrata sulla persona, in grado di rispondere dinamicamente al contesto. Questo porta a maggior tempo di permanenza, più azioni completate, meno abbandoni. Dal punto di vista del design, il concetto di layout fisso viene superato: le interfacce sono rigenerate dall’AI ogni volta che l’utente cambia. L’interazione diventa personalizzata al livello più profondo.

L’architettura informativa stessa può essere riscritta live. Le sezioni possono riordinarsi in funzione del comportamento. I contenuti si modulano come una sinfonia digitale adattiva. Questo è il nuovo volto del design responsivo: non solo adatto ai device, ma alle emozioni, ai percorsi e ai pensieri dell’utente. Un’esperienza umana, potenziata artificialmente.

Strumenti AI multimodali per designer e marketer

Il panorama degli strumenti AI creativi multimodali è oggi così ricco e dinamico da costituire un vero e proprio arsenale per chi lavora nel mondo del design, del marketing e della comunicazione visiva. Dalla generazione video alla costruzione di presentazioni, dalla sintesi vocale alla creazione di avatar realistici, i tool disponibili coprono ogni esigenza produttiva. La vera sfida non è accedervi, ma capire quale combinazione di piattaforme sia davvero utile per ogni specifico flusso operativo.

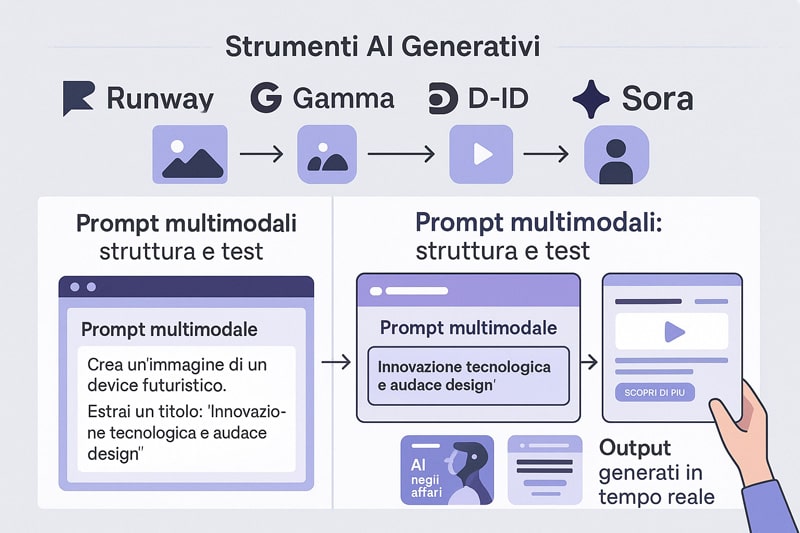

Tra le suite creative più efficaci troviamo Runway, Gamma, D-ID e Sora, ognuna con caratteristiche distintive. Alcuni strumenti puntano sull’immediatezza e sull’usabilità (Gamma), altri su prestazioni visive di livello cinematografico (Runway), mentre D-ID si posiziona nel campo dell’interazione umana-emotiva e Sora apre scenari di storytelling immersivo. La scelta va fatta in base al tipo di contenuto da produrre, al pubblico da raggiungere, e agli obiettivi della comunicazione.

Integrare una o più di queste piattaforme in un workflow significa ripensare radicalmente la sequenza del processo creativo: l’ideazione non è più un atto isolato, ma diventa il punto di partenza per una catena automatizzata e personalizzabile. Ad esempio, un prompt strutturato può generare una bozza video, una sequenza slide, una sintesi vocale, e perfino uno script SEO-ready per il blog aziendale, tutto in pochi minuti.

Inoltre, queste piattaforme offrono pannelli di controllo visivi, interfacce semplificate e strumenti di refining che consentono a professionisti non tecnici di ottenere risultati professionali. Il professionista digitale di oggi deve imparare a comporre suite AI coerenti, ragionando per obiettivi e risultati, non per tool. Il valore non sta nell’avere cento strumenti diversi, ma nel saperli combinare in modo intelligente, armonico, e soprattutto, replicabile. Questo è il nuovo paradigma della creative automation.

Confronto tra tool: Runway, Gamma, D-ID, Sora

Analizzare e comparare i principali strumenti AI creativi è fondamentale per comprendere le loro reali applicazioni nel mondo del content design e del marketing digitale. Runway, ad esempio, è oggi il punto di riferimento per la generazione video: consente di creare contenuti in stile cinematografico a partire da prompt testuali, offre funzioni avanzate di editing frame-by-frame e supporta voiceover automatizzati. Ideale per designer e videomaker, si integra bene con flussi narrativi visuali complessi.

Gamma, invece, è pensato per chi lavora con la comunicazione visiva rapida: consente di generare presentazioni interattive e responsive a partire da un semplice input testuale. È perfetto per marketer, team sales, e content strategist che desiderano costruire narrazioni visive coerenti senza passare da PowerPoint o Canva. In pochi minuti, una slide deck professionale prende forma, con contenuti ottimizzati per tono, struttura e impatto visivo.

D-ID si concentra su narrazione visiva e umana: volti animati, voci sintetiche espressive, avatar per onboarding o presentazioni video. È ideale per branding emozionale, spiegazioni guidate o automazioni conversazionali. La qualità del lip-sync e la possibilità di adattare la lingua lo rendono estremamente utile in contesti internazionali.

Infine, Sora, sviluppato da OpenAI, è ancora in fase di rilascio ma già promette una rivoluzione nella produzione video. Può generare sequenze filmiche ad alta definizione da prompt molto dettagliati, simulando movimenti di camera, transizioni, effetti di luce e narrazione visiva immersiva.

Il consiglio è chiaro: non esiste il migliore in assoluto, ma il migliore per il tuo flusso. L’approccio corretto è testare, confrontare, definire un mix tool-oriented coerente con i propri obiettivi e canali. Solo così potrai massimizzare ROI e creatività nel tuo AI toolkit quotidiano.

Prompt multimodali: come costruirli e testarli

Un prompt multimodale è molto più di una richiesta generica: è un’istruzione strutturata, capace di guidare l’intelligenza artificiale attraverso più canali di output — testo, immagini, audio, video — mantenendo coerenza narrativa, visiva e funzionale. Progettare un prompt efficace significa avere chiarezza sull’obiettivo comunicativo e sul tipo di esperienza che si vuole generare.

La costruzione di un prompt parte da quattro elementi fondamentali: intento, formato, tono e canale di output. Un esempio per Runway potrebbe essere: “Crea un video promozionale in stile documentario, con inquadrature lente, colonna sonora emotiva e voiceover femminile, ambientato in una metropoli notturna.” Questo prompt specifica non solo l’output atteso, ma anche lo stile, il ritmo e il mood.

Questa infografica sintetizza l’intero processo: dalla scelta dello strumento AI alla costruzione del prompt fino alla generazione dei contenuti.

Per Gamma, un buon prompt potrebbe essere: “Presentazione professionale a 6 slide sul futuro del design AI, con layout pulito, immagini astratte in tonalità blu, titoli brevi e bullet point visivi.” Qui è la struttura del contenuto a guidare l’output.

L’efficacia del prompt si misura con l’output: più l’output è vicino all’intenzione iniziale, più il prompt è preciso. Tecniche avanzate come il prompt chaining (concatenazione di richieste), il prompt iteration (test successivi con variazioni) e la prompt calibration (adattamento progressivo) aiutano a ottimizzare la generazione. In pratica, il prompt diventa una forma di design linguistico, dove la parola guida il processo creativo.

Il professionista del futuro sarà anche un prompt designer: non colui che sa usare l’AI, ma chi sa parlare con l’AI in modo efficace, intenzionale e produttivo. Saper scrivere un prompt multimodale significa avere potere sulla narrazione, sul ritmo, sull’estetica. E su tutto ciò che viene dopo.

Caso studio: agenzia italiana che lavora con AI generativa

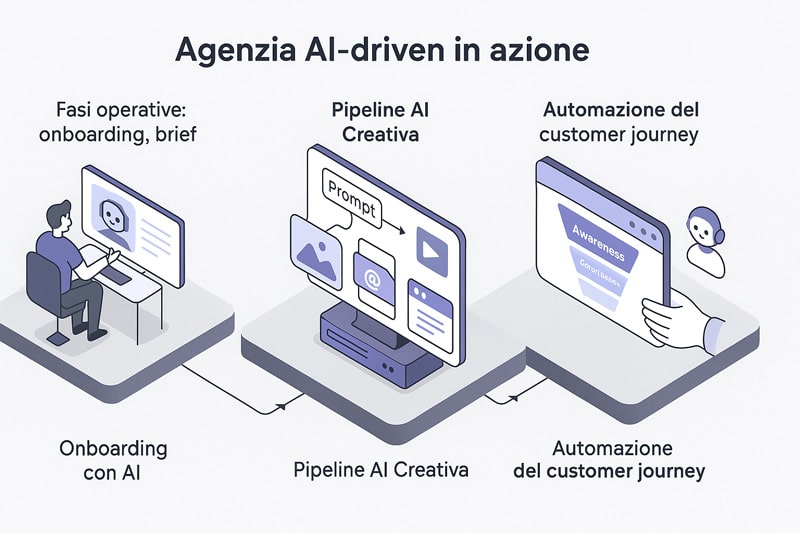

In Italia esistono realtà che stanno ridefinendo la propria identità operativa attraverso l’adozione dell’intelligenza artificiale generativa. Tra queste spicca un’agenzia digitale con base a Bologna, specializzata in web design, marketing strategico e sviluppo WordPress. Non ha semplicemente aggiunto qualche plugin AI al proprio arsenale, ma ha ristrutturato l’intero flusso produttivo inserendo strumenti multimodali e agenti AI autonomi in ogni fase, dall’ingaggio del cliente alla pubblicazione.

Ecco una rappresentazione visiva delle fasi chiave che mostrano come un’agenzia italiana integra l’AI nel proprio processo creativo.

Il processo non è stato improvvisato. Inizialmente è stato fatto un audit dei task interni più ripetitivi e time-consuming, come la creazione di wireframe base, la scrittura di copy informativi e la gestione delle revisioni. In una seconda fase sono stati selezionati strumenti AI in grado di automatizzare, assistere e co-progettare: Runway per i video promozionali, Gamma per presentazioni cliente, agenti GPT per microcopy e gestione brief, e uno stack proprietario per l’orchestrazione.

Il risultato? Un flusso creativo coordinato, snello e scalabile, dove ogni componente del team umano lavora affiancato da un agente AI dedicato. Questo ha permesso all’agenzia di ridurre del 42% il tempo medio di consegna e di aumentare del 30% la soddisfazione cliente nelle survey post-progetto. Più importante ancora, ha liberato risorse umane per attività ad alto valore strategico: analisi, concept, direzione creativa.

Questo caso italiano dimostra che l’adozione dell’AI nei flussi creativi non è solo tecnicamente possibile, ma vantaggiosa. Se supportata da una visione chiara, una formazione minima e una strategia d’integrazione, l’AI diventa partner e amplificatore, non minaccia. È la differenza tra un’agenzia che rincorre i brief e una che li anticipa e li moltiplica in soluzioni pronte, intelligenti e coerenti.

Fasi operative: onboarding, brief, produzione

Il primo snodo affrontato dall’agenzia è stato l’onboarding: la fase di acquisizione cliente è stata ristrutturata attorno a un sistema di agenti AI. Invece di form lunghi e colloqui iniziali ridondanti, viene attivato un’interfaccia conversazionale che interagisce con il cliente, analizza i suoi materiali esistenti (sito, brochure, profili social) e genera un documento automatico con SWOT, benchmark, buyer persona e proposte iniziali. Il tutto in meno di dieci minuti, con una qualità superiore a quella ottenuta tramite modelli manuali.

La fase di briefing è altrettanto trasformata: il cliente dialoga con un agente progettato per estrarre esigenze implicite, toni preferiti, obiettivi funzionali e vincoli progettuali. Il sistema propone automaticamente moodboard visivi, stili grafici, naming ipotetici, e persino una mappa concettuale dei contenuti. Il team umano analizza e valida questi dati per avviare la co-creazione, accorciando i tempi di analisi preliminare.

Durante la produzione, ogni reparto lavora in tandem con un assistant AI: il copywriter interagisce con modelli LLM pre-addestrati sul tono del brand; il designer utilizza prompt testuali per generare bozze grafiche; lo sviluppatore impiega agenti per generare skeleton HTML/CSS e snippet personalizzati. Ogni output è registrato, versionato e integrabile grazie a prompt condivisi in un sistema centrale.

Questa pipeline AI-powered ha permesso di standardizzare senza appiattire, conservando la personalizzazione per ogni cliente. Il lavoro del team è diventato più focalizzato: meno gestione, più concept. Le revisioni sono calate, le consegne anticipate, il cliente coinvolto sin dalla prima iterazione grazie a prototipi dinamici generati già dopo poche ore.

Blog AI-powered: contenuti multimodali e metriche reali

La realizzazione di un blog interamente generato con intelligenza artificiale multimodale non è più una sperimentazione di frontiera, ma un’opzione concreta per content creator, agenzie digitali e brand editoriali. In Italia, diverse realtà stanno adottando piattaforme generative per automatizzare la produzione, ottimizzare la distribuzione e migliorare la resa dei contenuti, senza sacrificare qualità o autenticità.

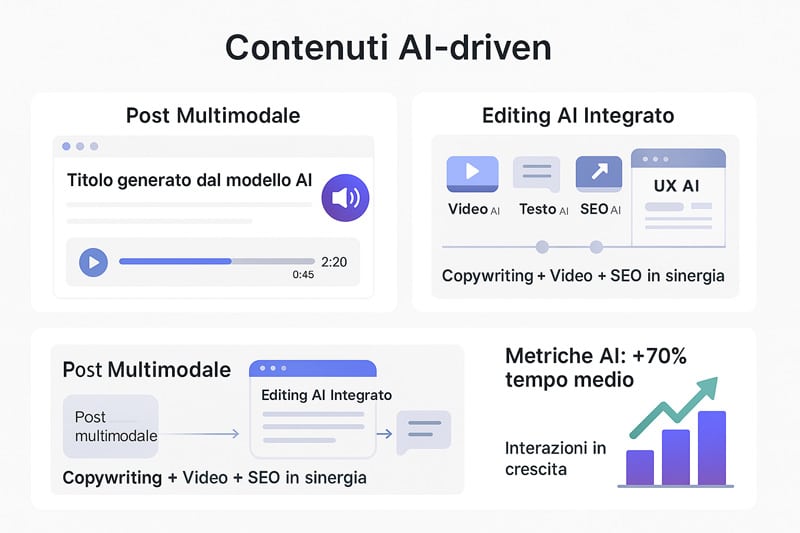

Questa infografica mostra come un blog supportato da AI possa generare contenuti integrati e ottenere risultati concreti in termini di performance.

Uno dei casi più interessanti è quello di un blog dedicato a tecnologia, innovazione e digital marketing che ha implementato una pipeline AI integrata in ogni fase del processo. Il sistema riceve un brief strutturato (formato, target, intento informativo) e genera una bozza testuale ottimizzata SEO, un’immagine in stile coerente con il branding, un voiceover sintetizzato e un video promozionale di accompagnamento. Tutto in pochi minuti, con output già adattati ai diversi canali: blog, newsletter, YouTube Shorts, Reels, LinkedIn carousel.

ai La strategia si basa su prompt evoluti che attivano una suite di strumenti interconnessi: GPT‑4o per il copy, DALL·E per la grafica, ElevenLabs per la voce e Runway per l’editing video. Ogni contenuto nasce pensato per essere multicanale, modulare e ricombinabile, ideale per la pubblicazione a cascata su più piattaforme con minime revisioni umane.

La redazione interviene nella fase di validazione, garantendo tono di voce, allineamento agli obiettivi e rispetto delle policy editoriali. Questo permette di moltiplicare la frequenza di pubblicazione senza perdita di coerenza, e soprattutto di liberare tempo da dedicare ad analisi, strategia e relazione con il pubblico. Il risultato? Un modello editoriale più agile, più scalabile e in linea con le nuove aspettative dell’informazione digitale contemporanea.

Editing video + voiceover + copy SEO integrato

Produrre contenuti con l’ausilio dell’intelligenza artificiale non significa solo “scrivere più velocemente”: significa generare valore attraverso un flusso creativo sinergico, in cui ogni elemento — testo, immagine, suono, video — è coordinato da un’intenzione narrativa precisa. In un blog AI-powered, ogni articolo nasce da un prompt centralizzato che specifica argomento, stile, formato, pubblico e canali previsti.

Il copy SEO viene generato con LLM specializzati, segmentato in sezioni ottimizzate per H2, H3, snippet e long-tail. In parallelo, viene scritto uno script per voiceover, generato in tempo reale con voci sintetiche altamente naturali (es. ElevenLabs), mentre un motore grafico come DALL·E o Midjourney produce la thumbnail in linea con il mood comunicativo. Un ulteriore step attiva un editor video AI come Runway, che monta uno short narrativo automatico: immagini, musica, voiceover e CTA si fondono in pochi secondi.

Questo sistema consente la creazione di asset coordinati e coerenti, pronti per essere pubblicati su WordPress, social media e piattaforme audio/video. Non è un collage di strumenti, ma un ecosistema di automazioni intelligenti orchestrato a partire da un’unica matrice: il prompt.

Inoltre, il contenuto è pensato per adattarsi alla piattaforma: il video si monta in verticale per Reels, la sintesi testuale viene inviata via email, la versione lunga resta sul blog. Ogni elemento supporta e rafforza gli altri. Questo approccio non solo riduce tempi e costi, ma aumenta la qualità percepita, genera engagement e migliora le metriche legate al tempo di lettura, al click-through e alla permanenza sulla pagina.

Risultati ottenuti: traffico, interazioni, tempo lettura

Dopo sei mesi di attività basata su intelligenza artificiale, il blog AI-powered ha evidenziato un miglioramento netto e misurabile delle performance editoriali. I dati raccolti evidenziano un +62% di traffico organico mensile, un incremento del tempo medio per sessione da 1’58” a 3’21”, e una riduzione del bounce rate di circa 18 punti. La pipeline AI ha permesso di aumentare la frequenza di pubblicazione da 2 a 5 post settimanali, mantenendo elevata la qualità percepita.

Ma non è solo quantità: anche le metriche qualitative sono cresciute. I post con video e voiceover integrati hanno mostrato un +48% di CTR nelle preview Discover e un aumento significativo di condivisioni social. Gli utenti hanno passato più tempo sui contenuti grazie alla multicanalità: leggono, guardano, ascoltano. L’effetto immersivo riduce la fatica cognitiva e potenzia la comprensione del messaggio.

In termini di strategia, la redazione ha potuto riallocare il tempo risparmiato verso attività più rilevanti: revisione, A/B test, interazione con il pubblico, analisi comportamentale. La produzione automatizzata ha reso possibile anche il test di nuovi format: storytelling interattivo, articoli navigabili, contenuti quiz-driven. Il tutto, mantenendo coerenza di branding e tono redazionale.

I KPI principali hanno registrato incrementi stabili: +41% traffico organico YoY, +35% engagement medio per contenuto, +23% conversioni attribuite. È la dimostrazione concreta che l’AI, se ben implementata, non è solo un acceleratore, ma anche un amplificatore strategico delle metriche editoriali. L’intelligenza artificiale non si limita a produrre contenuto: lo fa meglio, in meno tempo, con più risultati.

Come creare un team ibrido: umano + agente AI

Costruire un team ibrido umano + agente AI non è più un’ipotesi teorica, ma una configurazione operativa concreta, richiesta da aziende e agenzie che intendono scalare i propri flussi di lavoro mantenendo alta la qualità. L’intelligenza artificiale, se correttamente assegnata e orchestrata, non è un sostituto dell’umano, ma un collaboratore specializzato che gestisce task ripetitivi, analitici o generativi in tempi ridottissimi.

Per strutturare un team efficiente, si parte dalla mappatura dei processi: ogni fase viene analizzata per identificare quali attività sono automatizzabili e quali richiedono supervisione umana. Ad esempio: ricerca keyword, analisi competitor, generazione bozza, produzione wireframe, gestione calendari editoriali. A ognuna di queste si assegna un agente AI o una funzione automatica, con un flusso ben definito e obiettivi misurabili.

La seguente infografica mostra in modo sintetico i ruoli distinti e complementari di esseri umani e agenti AI all’interno di un team ibrido.

La chiave del successo è il coordinamento uomo-macchina: l’umano imposta il framework strategico, mentre l’AI opera entro confini chiari, con check di validazione obbligatori. È un modello che impone una nuova cultura del lavoro, basata su delega intelligente, supervisione consapevole e responsabilità distribuita. L’agente AI non prende decisioni in autonomia, ma genera proposte, esplora alternative, pre-elabora dati. Il team umano valuta, corregge, approva.

Questa configurazione consente di ridurre errori, accelerare le consegne e aumentare la scalabilità senza stress operativo. Un team ibrido può essere operativo 24/7, gestire più progetti in parallelo e garantire standard qualitativi elevati, purché sia guidato da processi ben documentati, KPI realistici e una governance chiara dei limiti tra umano e artificiale.

Ruoli, limiti, supervisione: cosa resta umano

In un team ibrido è fondamentale chiarire chi fa cosa: non tutti i compiti devono essere affidati all’intelligenza artificiale, e non tutte le decisioni possono essere delegate a un algoritmo. La distinzione tra attività operative e strategiche è il primo passo per una collaborazione efficiente. Le attività meccaniche, ad alto volume e basso rischio, possono essere gestite da agenti AI. Tutto ciò che richiede sensibilità, visione e responsabilità rimane nelle mani dell’essere umano.

I ruoli vanno quindi formalizzati. Gli agenti AI si occupano di generare contenuti grezzi, organizzare dati, suggerire alternative. Ma il filtraggio finale deve sempre essere umano: una figura con competenze editoriali, UX o strategiche che valuta e corregge. Questo garantisce non solo la qualità, ma anche l’allineamento etico e semantico rispetto agli obiettivi di progetto.

È necessario introdurre meccanismi di auditing AI: quanti output vengono approvati al primo colpo? Quali errori ricorrono? I dati raccolti servono a calibrare meglio i prompt, ma anche a misurare la reale utilità dell’automazione. L’AI non è infallibile, ma può apprendere: ed è proprio il confronto con il controllo umano a raffinare i risultati nel tempo.

Inoltre, la supervisione umana assume un ruolo narrativo: interpreta l’output, lo valorizza e lo integra in un contesto più ampio. È qui che avviene la differenza tra un contenuto “corretto” e un contenuto “coinvolgente”. La soglia critica AI non sta nel cosa può fare, ma nel come va inserita in un ecosistema dove le decisioni restano umane, supportate da dati intelligenti.

Dove portano più valore gli agenti AI

Gli agenti AI generano valore quando operano in contesti ripetitivi, scalabili e a basso margine di rischio. Questo non significa affidar loro operazioni marginali, ma sfruttarne la potenza in quelle zone AI-friendly dove automazione e performance coincidono. Alcuni esempi: generazione di titoli SEO, clustering keyword, costruzione wireframe, compilazione form, assistenza al copywriting e testing di varianti grafiche o semantiche.

Un team che integra agenti AI in queste fasi sperimenta un impatto diretto su ROI e produttività. I contenuti vengono generati più velocemente, con proposte multiple tra cui scegliere; i funnel possono essere ottimizzati in tempo reale; le risposte ai clienti automatizzate con personalizzazioni basate sui comportamenti reali.

Tuttavia, non tutto va automatizzato. I compiti in cui gli agenti portano più valore sono quelli dove agiscono da “booster” al pensiero umano. Un esempio: un’AI che crea tre headline creative per un articolo fornisce opzioni rapide che un editor può valutare e rifinire. Oppure un agente che compone uno script base per un video lascia poi spazio al team per curare ritmo, empatia, storytelling.

In termini numerici, l’integrazione efficace degli agenti AI ha mostrato ritorni immediati: riduzione tempi di consegna (–35%), aumento task completati/settimana (+52%), incremento qualità percepita in survey interne. Non è solo produttività: è potenziamento intelligente. L’AI non sostituisce la creatività, la espande. Non cancella la strategia, la abilita. Dove agisce con misura, genera impatto tangibile.

Prompt design per marketing e creatività

Nel contesto del marketing moderno, il prompt design rappresenta una nuova competenza strategica. Costruire un prompt efficace significa trasformare un’intenzione comunicativa in una sequenza strutturata, capace di istruire un modello AI per generare output coerenti, ottimizzati e immediatamente utilizzabili. Non è una frase scritta al volo, ma un codice operativo, una sintassi progettuale che definisce contenuto, tono, formato e obiettivo.

La seguente infografica illustra la struttura visiva di un prompt efficace e tre esempi reali per l’applicazione nel marketing digitale.

Nel marketing, questa capacità si traduce in produttività potenziata: titoli pubblicitari, caption social, headline per landing page, email persuasive, script video, microcopy UX. Ma soprattutto, i professionisti che sanno progettare prompt modulari ed efficienti riescono a risparmiare tempo, ridurre le revisioni e generare contenuti più coerenti e performanti su ogni canale.

Il vero salto di qualità arriva con la standardizzazione dei prompt. Le agenzie più evolute stanno creando template pronti per ogni scenario: fase di funnel (awareness, consideration, decision), piattaforma (Instagram, TikTok, newsletter, YouTube), obiettivo (engagement, lead generation, conversione). È il passaggio da improvvisazione a progettazione, da input generico a comando strategico.

L’adozione di prompt design come metodologia permette anche test A/B veloci, controllo creativo distribuito e orchestrazione di campagne cross-channel. Inoltre, i prompt possono essere ottimizzati con parametri avanzati come temperatura, variabilità sintattica e profondità semantica. Non si tratta solo di “parlare con l’AI”, ma di scrivere per produrre risultati misurabili, con lo stesso rigore che si applica a un brief creativo tradizionale. Un prompt non è solo efficace se genera un output: è valido quando guida un’esecuzione performante.

Come costruire un prompt multimodale efficace

Un prompt multimodale efficace nasce dalla combinazione tra chiarezza linguistica e struttura logica, due elementi che, se ben bilanciati, permettono a qualsiasi modello AI di generare contenuti coerenti e ad alta utilità. Non si tratta di scrivere in modo generico, ma di specificare in ogni parte cosa si vuole, per chi, con quale finalità.

Un prompt strutturato inizia con una intestazione operativa: “Genera un carosello Instagram“, “Scrivi una headline per landing page“, “Crea uno script per video YouTube“. Questa sezione serve a dare il via al task e attiva il modello sulla modalità corretta.

Segue poi il blocco descrittivo, dove vengono elencati tutti i parametri rilevanti: tono di voce, obiettivi, dati chiave da includere, formato previsto. Ad esempio: “Usa un tono informativo ma accessibile, inserisci i benefici principali del prodotto e chiudi con una call-to-action rivolta ai freelance digitali“.

Un prompt ben fatto può includere anche istruzioni per il controllo dell’output: lunghezza, struttura (elenco, narrazione, confronto), variabili di creatività (temperature), elementi opzionali o da evitare. In ambito multimodale, si possono specificare asset integrati: “Testo + immagine + voiceover”, oppure “Descrizione + layout visivo + struttura per Reel”.

La coerenza narrativa tra i blocchi è cruciale. Un prompt deve essere modulare ma armonico, capace di essere riutilizzato e adattato a differenti contesti con poche modifiche. In questo senso, si configura come un linguaggio formale a tutti gli effetti. Non è la lunghezza che conta, ma la capacità di guidare con precisione l’esecuzione. È questa la nuova scrittura strategica, dove ogni parola diventa istruzione.

Prompt reali: ADV, social, landing page

Per comprendere appieno la potenza del prompt design, è utile osservare esempi reali applicati nei tre ambiti più comuni del marketing digitale: ADV, social media e landing page. Ogni scenario richiede una struttura dedicata, con istruzioni adatte al canale, al pubblico e all’obiettivo di conversione.

- ADV (Google Ads)

Prompt: “Scrivi 3 titoli da massimo 30 caratteri e 2 descrizioni da massimo 90 caratteri per una campagna Google Ads dedicata a un corso online di web marketing. Tono: diretto, professionale. Obiettivo: acquisire iscrizioni qualificate.” - Instagram Carousel + Caption

Prompt: “Crea una caption per Instagram per accompagnare un carosello di 5 slide sul tema ‘Come l’AI può aiutare i freelance a produrre di più in meno tempo’. Usa un tono ispirazionale, chiudi con un invito all’azione e inserisci 5 hashtag rilevanti.” - Landing Page Funnel

Prompt: “Genera headline, sottotitolo, 3 bullet point di beneficio, una sezione centrale con motivazione al click e una CTA finale per una landing page che promuove un webinar gratuito su prompt design per creativi. Target: marketer e designer digitali. Tono: autorevole ma accessibile.”

Questi esempi mostrano la granularità operativa dei prompt moderni: ogni parola diventa vincolo progettuale, ogni blocco istruisce una fase del contenuto. Si possono integrare anche comandi per l’adattamento cross-mediale come:

“Adatta lo stesso prompt per YouTube Shorts, email e LinkedIn post.”

Un buon prompt non solo attiva il modello, ma orienta verso risultati concreti: contenuti pubblicabili, metriche ottimizzate, risposte in linea con le esigenze reali.

È scrittura che guida. È strategia che comanda.

Limiti, sfide e rischi etici dell’AI generativa

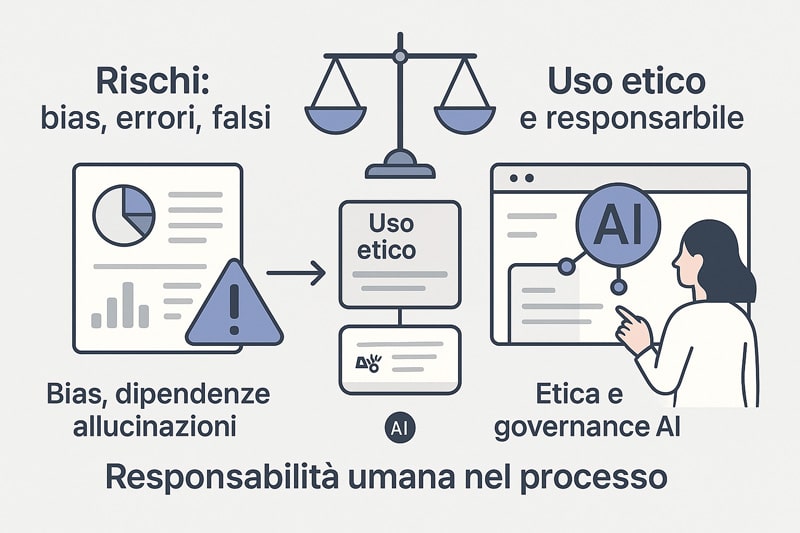

L’adozione massiva dell’intelligenza artificiale generativa ha evidenziato con forza alcuni limiti strutturali e rischi etici significativi che non possono più essere ignorati. Se da un lato i benefici sono evidenti in termini di produttività e velocità operativa, dall’altro emergono sfide profonde legate a governance, bias e trasparenza. I modelli generativi operano su base statistica: predicono la parola successiva più probabile sulla base di dati passati. Eppure, proprio questi dati spesso contengono distorsioni culturali, omissioni sistemiche o pregiudizi impliciti, che l’AI replica inconsapevolmente.

Questa infografica riassume i principali rischi connessi all’uso dell’AI e il ruolo essenziale della supervisione umana per garantire un uso responsabile.

Uno dei limiti più discussi è l’hallucination: l’AI genera contenuti plausibili ma inventati, con conseguente rischio di disinformazione, errori fattuali e danni reputazionali per i brand. Un altro punto critico è l’origine dei dataset: spesso non è chiaro chi ha fornito i dati, con quale licenza, e se rappresentano equamente tutti i gruppi sociali. Il risultato può essere un contenuto che discrimina, banalizza o omette, pur senza intenzionalità.

Anche la governance interna è spesso assente o lacunosa: chi approva gli output? Con quali criteri? E soprattutto, come si previene un uso irresponsabile o automatico della tecnologia? Senza un sistema di controllo umano costante, il rischio di sovra-affidarsi alla macchina è concreto. In mancanza di politiche aziendali etiche, l’AI rischia di essere percepita come neutra, quando invece riflette (e amplifica) le scelte e i valori di chi la imposta.

Infine, il tema etico si estende alla responsabilità. Chi è responsabile in caso di contenuto errato, ingannevole o dannoso? Il fornitore del modello? L’utente? L’azienda? Finché questi interrogativi resteranno aperti, sarà fondamentale affiancare a ogni uso dell’AI una cornice regolativa chiara, trasparente e verificabile.

Bias, errori, falsi contenuti e dipendenza

L’AI generativa, per quanto potente, è un sistema di probabilità, non di verità. I principali rischi operativi ed etici derivano dalla sua tendenza a generare contenuti statisticamente plausibili ma potenzialmente errati, fuorvianti o culturalmente distorti. Questo accade perché i modelli sono addestrati su dataset enormi ma non sempre bilanciati, e le istruzioni fornite dall’utente (prompt) possono innescare comportamenti non intenzionali.

I bias sono il primo fattore critico: se i dati di addestramento contengono stereotipi o squilibri, l’AI li replicherà, amplificandoli. Esempi reali includono contenuti sessisti, razzialmente polarizzati o esclusivi rispetto a certe minoranze. A ciò si aggiunge il fenomeno dell’hallucination, dove il modello “inventa” fatti, nomi, eventi, rendendo difficile verificare l’affidabilità dell’output.

Il secondo rischio è la dipendenza funzionale: quando le aziende delegano costantemente all’AI anche le scelte strategiche o creative, si verifica una perdita progressiva di pensiero critico e autonomia professionale. Si rischia un appiattimento dell’identità di brand, con contenuti simili, prevedibili e impersonali. La sovra-automatizzazione è utile per task tecnici, ma dannosa se applicata al pensiero strategico.

Infine, fenomeni più subdoli come il data poisoning (alterazione volontaria dei dati per sabotare i modelli) o l’over-reliance (affidarsi all’AI senza supervisione) mostrano che i rischi non sono solo teorici. Sono già operativi. È indispensabile mantenere presìdi di verifica umana, audit periodici, e una consapevolezza diffusa: l’AI è uno strumento, non un sostituto del pensiero.

Come usarla in modo etico e responsabile

Usare l’intelligenza artificiale in modo etico e responsabile non significa solo evitare errori, ma progettare un ecosistema di controllo e consapevolezza. Il punto di partenza è riconoscere che l’AI è fallibile, e che ogni output va verificato da persone competenti. Serve un modello operativo “human-in-the-loop”: l’umano non è opzionale, ma parte integrante del ciclo di produzione.

Una buona prassi è redigere linee guida etiche interne, che indichino quando e come l’AI può essere usata. Queste linee devono coprire: attribuzione dei contenuti generati, responsabilità redazionale, criteri di pubblicazione, livelli di autonomia concessa agli strumenti. Ogni contenuto creato da AI dovrebbe essere chiaramente etichettato, in modo che il pubblico possa distinguere tra umano e generato.

La trasparenza è centrale. Le aziende devono dichiarare quali modelli usano, quali prompt forniscono, e con quali obiettivi operano. Va evitata ogni ambiguità, soprattutto in ambiti sensibili come informazione, educazione, sanità, comunicazione istituzionale. L’uso etico dell’AI include anche la protezione dei diritti umani, il rispetto della diversità, l’adozione di sistemi inclusivi.

Un altro aspetto spesso trascurato è la formazione interna: i team che utilizzano l’AI devono essere formati non solo all’uso tecnico, ma anche alla gestione dei limiti, dei rischi e delle implicazioni etiche. L’AI non va lasciata agire “in automatico”. Va inserita in un progetto consapevole, regolato, e sempre osservabile. Solo così diventa davvero uno strumento evolutivo, e non un boomerang etico.

Il futuro: ambienti immersivi + AI generativa

L’evoluzione congiunta di AI generativa e ambienti immersivi segna l’avvio di una nuova fase nel web design e nel marketing digitale. Le tecnologie emergenti basate su realtà aumentata (AR), realtà mista (MR) ed extended reality (XR) non si limitano a integrare la grafica tradizionale, ma riplasmano l’intero ecosistema esperienziale dell’utente. In questo scenario, il sito web diventa un habitat interattivo, multidimensionale e adattivo.

L’immagine seguente rappresenta visivamente le componenti immersive e personalizzabili di un’esperienza web basata su AI generativa e realtà aumentata.

L’AI immersiva consente oggi di generare contenuti in tempo reale non solo su base testuale, ma anche audio-visiva e sensoriale, trasformando ogni touchpoint in un’esperienza aumentata e contestuale. Attraverso l’utilizzo di generative agents, reti neurali multimodali e interfacce neurali adattive, la progettazione si estende oltre il design visivo, coinvolgendo voce, movimento, contesto ambientale e feedback emotivo.

Nel marketing, questa sinergia permette l’orchestrazione intelligente del funnel: contenuti che si adattano in tempo reale al comportamento dell’utente, con micro-narrazioni guidate, offerte dinamiche e ambienti reattivi. L’AI può personalizzare texture, luci, testi e percorsi di navigazione, rendendo ogni sessione unica e irripetibile.

Tuttavia, questa potenza apre anche sfide: la UX deve adattarsi a percorsi non lineari, la progettazione deve considerare parametri sensoriali e il controllo dell’utente sull’interazione deve essere garantito. Siamo entrati nell’era del design esperienziale neurale, dove l’AI non supporta soltanto la comunicazione, ma la plasma attraverso nuovi linguaggi.

Il web non si guarda, si attraversa.

Verso interazioni sensoriali totali nei siti web

I siti web del futuro non saranno semplici collezioni di layout o contenuti visuali, ma ambienti dinamici in grado di rispondere sensorialmente ed emotivamente all’utente. Le nuove interfacce AI si basano su input multisensoriali come il movimento del corpo, il tono della voce, lo sguardo e persino i micro-movimenti facciali, analizzati tramite webcam, sensori o dispositivi indossabili.

In questo contesto, la UI tradizionale si evolve in UI reattiva, dove il design si modifica in tempo reale: colori, forme, transizioni e contenuti si adattano al comportamento o allo stato emotivo del visitatore. Ad esempio, un utente indeciso potrà ricevere un prompt rassicurante, mentre un utente veloce potrà essere guidato verso call-to-action rapide. Il tutto orchestrato da AI che apprendono dal comportamento e adattano l’esperienza secondo micro-segmentation predittiva.

Tali dinamiche sono rese possibili da reti neurali multimodali, in grado di processare simultaneamente testo, immagine, voce e movimento. Il sito web diventa un organismo adattivo che ascolta, risponde e si trasforma. Questo non solo aumenta il coinvolgimento, ma eleva la percezione di personalizzazione a livelli mai raggiunti prima.

Non si tratta di una visione futuristica, ma di una direzione già in atto: player come Meta, NVIDIA e Runway AI stanno integrando AI interattive e sensori ambientali nelle esperienze web. Per i designer, la sfida sarà progettare ambienti non più statici ma in perenne mutazione, dove ogni dettaglio è progettato per interagire, risuonare, adattarsi.

Mixed Reality e agenti AI nei percorsi utente

La Mixed Reality, combinata con agenti AI generativi, consente la nascita di esperienze digitali in cui l’utente non è più spettatore passivo, ma parte attiva di un ecosistema adattivo. Il contenuto non viene più semplicemente visualizzato: si manifesta nello spazio fisico attraverso dispositivi AR/MR, e si modella in tempo reale grazie agli agenti intelligenti.

Nel marketing, questo significa percorsi utente completamente contestualizzati e situazionali. L’AI può identificare posizione, comportamento, intenzione e persino umore, offrendo contenuti pertinenti al momento esatto. Ad esempio, entrando in uno store fisico, il cliente può ricevere suggerimenti visivi sovrapposti tramite AR, generati da un’AI che conosce i suoi gusti, il suo storico d’acquisto e il suo comportamento di navigazione.

Gli agenti AI autonomi, all’interno di ambienti immersivi, possono orchestrare funnel personalizzati: dal primo contatto alla conversione, tutto avviene all’interno di una narrazione aumentata, dove ogni azione dell’utente genera una reazione specifica. Il web design diventa drammaturgia interattiva, la UI diventa regia.

Questa convergenza porta con sé opportunità straordinarie, ma richiede nuove competenze: progettazione tridimensionale, storytelling reattivo, scrittura di prompt sensibili al contesto. Non si tratta solo di incorporare tecnologia, ma di riscrivere le regole del coinvolgimento.

Il futuro non è un’interfaccia più bella: è un’esperienza che si evolve con te.

Checklist operativa: integrare AI nei flussi creativi

Integrare l’intelligenza artificiale nei flussi creativi non è più un’opzione futuribile, ma un passo necessario per chi lavora in ambiti come design, marketing, contenuti digitali e branding. La complessità tecnologica è reale, ma può essere ridotta se affrontata con metodo. Ecco una checklist operativa concreta per iniziare, testare e ottimizzare l’uso dell’AI nel lavoro quotidiano.

1. Identifica i task ad alto carico ripetitivo

Cosa fai ogni giorno che potresti automatizzare o accelerare? Esempi classici: riscrittura contenuti, varianti per A/B test, resize grafico, trascrizioni, ideazione naming. Sono i punti ideali in cui l’AI porta efficienza immediata.

2. Scegli gli strumenti giusti per ogni esigenza

Non serve usarli tutti: serve usarli bene. Ecco una mappa orientativa:

– Testo: Jasper, Notion AI, ChatGPT

– Immagini: Midjourney, DALL·E, Leonardo AI

– Video: Runway, Pika Labs, Sora

– Voce: ElevenLabs, D-ID

– Prompting: PromptHero, FlowGPT

3. Costruisci un tuo starter kit personalizzato

Prepara un documento con: prompt base, tone of voice, palette visiva, formati output, flussi editoriali, e obiettivi per ciascuna piattaforma. È il tuo sistema AI assistito, replicabile e condivisibile.

4. Applica l’AI nei punti strategici del funnel creativo

Non ovunque, ma dove serve: idea generation, script copy, generazione visual, ottimizzazione CTA, adattamenti cross-platform. Ogni fase può essere migliorata senza perdere autenticità.

5. Misura ciò che conta davvero

Confronta KPI prima e dopo l’integrazione: tempo di produzione, engagement, CTR, qualità percepita, conversioni. La creatività supportata da AI è anche misurabile.

6. Fai retrospettive periodiche

Ogni mese, rivedi prompt, tool, metriche, errori. L’AI evolve. I tuoi processi devono evolvere con essa. Documenta le best practice, elimina gli attriti, aggiorna le sequenze.

Con questa roadmap, l’AI smette di essere “tecnologia da capire” e diventa alleato concreto da attivare.

La creatività non si sostituisce: si espande.

Domande frequenti sull’uso dell’AI in web design e marketing

❓ Come iniziare a usare l’AI nel web design e marketing?

Un’introduzione efficace all’AI parte dalla definizione dei propri obiettivi: migliorare i tempi, la qualità dei contenuti o la personalizzazione? Inizia da strumenti semplici come Runway o Gamma per la produzione grafica, e sperimenta prompt base per landing page e post social. L’importante è testare piccoli task, con supervisione umana. L’articolo include esempi e tool pratici per partire.

❓ Qual è la differenza tra AI generativa e automazione classica?

L’AI generativa crea contenuti nuovi (testi, immagini, video) a partire da input specifici, mentre l’automazione classica esegue operazioni ripetitive predefinite. In marketing, usare l’AI generativa significa integrare creatività e strategia. Nell’articolo sono mostrati casi concreti, strumenti ibridi e come sfruttare entrambe.

❓ Quanto può aumentare il ROI usando l’AI generativa?

L’impatto dell’AI sul ROI dipende da come viene integrata. Un workflow ottimizzato può ridurre il tempo di produzione del 70% e aumentare la conversione delle landing fino al 30%, come riportano i casi studio inclusi nell’articolo. Il vero valore nasce dall’allineamento tra prompt, obiettivi e metriche.

❓ Esistono strumenti e prompt AI gratuiti per cominciare?

Sì. Tool come Gamma, Canva AI, Copilot (in beta) o strumenti da Google Labs permettono di iniziare gratuitamente. Anche piattaforme come PromptHero o FlowGPT offrono esempi validi di prompt. Nell’articolo trovi risorse e tecniche testate per iniziare con budget zero.

❓ L’AI generativa è compatibile con WordPress e i tool marketing?

Assolutamente sì. L’AI può integrarsi tramite plugin (es. Bertha AI, AI Engine) o connessa via API a CRM e sistemi email. In fase di web design, può supportare la generazione di testi, immagini, e layout tramite prompt. L’articolo esplora queste integrazioni con esempi reali.

❓ Quali sono i rischi legali nell’uso dell’intelligenza artificiale?

Oltre ai bias e agli errori, esistono rischi legali legati a copyright, privacy e trasparenza dei dati. Se usi contenuti generati, è fondamentale citare le fonti, evitare contenuti ingannevoli e prevedere supervisione editoriale. L’articolo dedica una sezione all’uso etico e responsabile.

❓ Come capire se i contenuti generati dall’AI funzionano davvero?

Monitora KPI come traffico organico, tempo di permanenza e CTR. Ma osserva anche la pertinenza semantica e l’engagement utente. I contenuti AI di qualità si riconoscono dalla coerenza, chiarezza e impatto. Nell’articolo sono riportati dati reali da blog e agenzie italiane.