Google ha annunciato l’update BERT al suo algoritmo la scorsa settimana, quello che hanno definito l’aggiornamento più significativo in cinque anni, dopo l’aggiornamento RankBrain del 2015.

Secondo il comunicato, Google afferma che BERT influenzerà il 10% delle query, il che significa che Google sarà in grado di comprendere meglio una query su dieci, in un modo simile in cui gli umani le comprendono. Con questo aggiornamento, Google presta maggiore attenzione al contesto di ricerca e a ogni parola nella query di ricerca.

La tecnologia alla base di questo nuovo aggiornamento è una tecnica basata sulla rete neurale per l’elaborazione del linguaggio naturale ( Natural Language Processing, NLP ) chiamata “Bidirectional Encoder Representations from Transformers” o BERT.

L’aggiornamento Google BERT è stato annunciato ufficialmente il 25 ottobre 2019, ma Google ha riferito che era già stato lanciato da qualche giorno. Google ha parlato per la prima volta dell’aggiornamento BERT l’anno scorso.

I trasformatori sono uno degli sviluppi avanzati più recenti nel campo dell’apprendimento automatico. Funzionano perfettamente per i dati e sono uno strumento utile per lavorare con l’elaborazione del linguaggio naturale e le query di ricerca. La tecnica prevede l’insegnamento dei sistemi per comprendere correttamente il contesto e l’ordine in cui appare una parola.

E questo aggiornamento BERT segna anche la prima volta che Google utilizza i suoi ultimi chip TPU ( Tensor Processing Unit ) per fornire risultati di ricerca.

BERT è il più importante aggiornamento di Google dopo RankBrain

Secondo Google, questo nuovo aggiornamento influenzerà le query di ricerca complicate che dipendono dal contesto di ricerca.

Questo è ciò che Pandu Nayak, il vicepresidente della ricerca di Google ha da detto sul nuovo aggiornamento:

“At Google’s core, Search is understanding the language we use. And by applying BERT models to both rankings and featured snippets in search, we’re able to understand and do a much better job helping everyone find useful information in their search results. When it comes to ranking search results, BERT will help search better understand 1 in 10 searches in the U.S. in English.

Particularly for longer, more conversational queries, or searches where prepositions like “for” and “to” matter a lot to the meaning, Search will be able to understand the context of the words in your query. And as a result, you can search in a way that feels natural for you.”

BERT è il più grande passo avanti negli ultimi 5 anni e uno dei più grandi nella storia della Search, porta risultati migliori, dice Pandu Nayak, e può aiutare i computer a comprendere meglio il linguaggio degli umani, o verosimilmente, nello stesso modo di come fanno gli umani.

Che cos’è l’aggiornamento Google BERT?

Il nuovo aggiornamento è focalizzato su un’interpretazione migliore dell’intento delle query di ricerca.

Piuttosto che guardare la query di ricerca dell’utente parola per parola, BERT consente a Google di interpretare meglio l’intera frase per dare al ricercatore risultati più accurati, proprio come gli umani interpretano una frase.

Anche modifiche sparse o anche semplici parole in una query di ricerca possono alterare notevolmente l’intento di ricerca. Tuttavia, l‘aggiornamento non verrà utilizzato per il 100% delle ricerche. Per ora, questo aggiornamento verrà utilizzato su 1 su 10 risultati di ricerca negli Stati Uniti in inglese.

Secondo Google, BERT è un aggiornamento molto complesso che spinge i limiti dell’hardware di Google, motivo per cui probabilmente viene utilizzato solo per un numero limitato di ricerche.

Gli effetti di Google BERT sulle SERP

Google ha presentato alcuni esempi nel suo annuncio ufficiale:

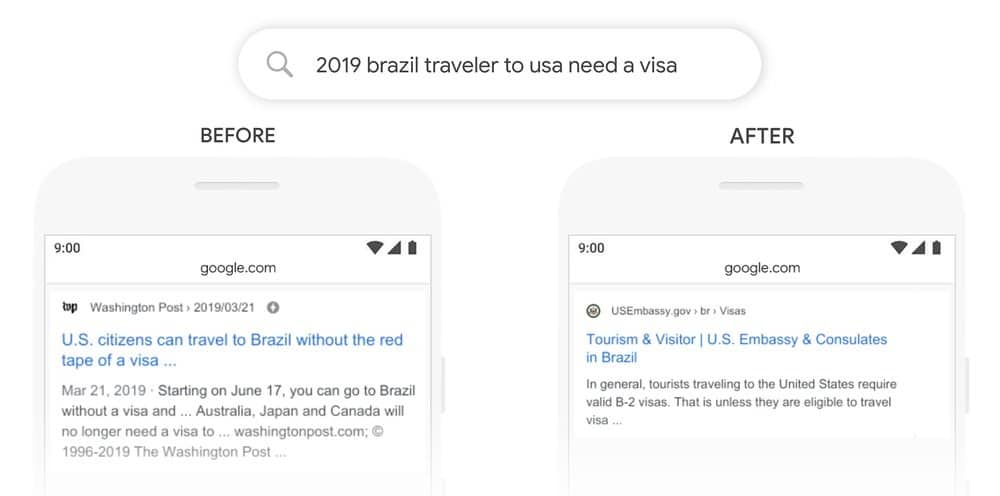

Esempio 1

Nel loro esempio, è una ricerca di “Un brasiliano ha bisogno del visto per un viaggio verso gli Stati Uniti?”. Per comprendere il significato di questa ricerca, è essenziale comprendere la parola “a” e la sua relazione con altre parole nella query di ricerca. Fino a poco tempo fa ci saremmo imbattuti in risultati grezzi o non pertinenti. Questo perché Google non avrebbe preso in considerazione le parole di collegamento come “bisogno” e soprattutto “verso”, mostrando magari risultati inversi e opposti, come siti che spiegano ai cittadini americani se sia necessario il visto per visitare il Brasile.

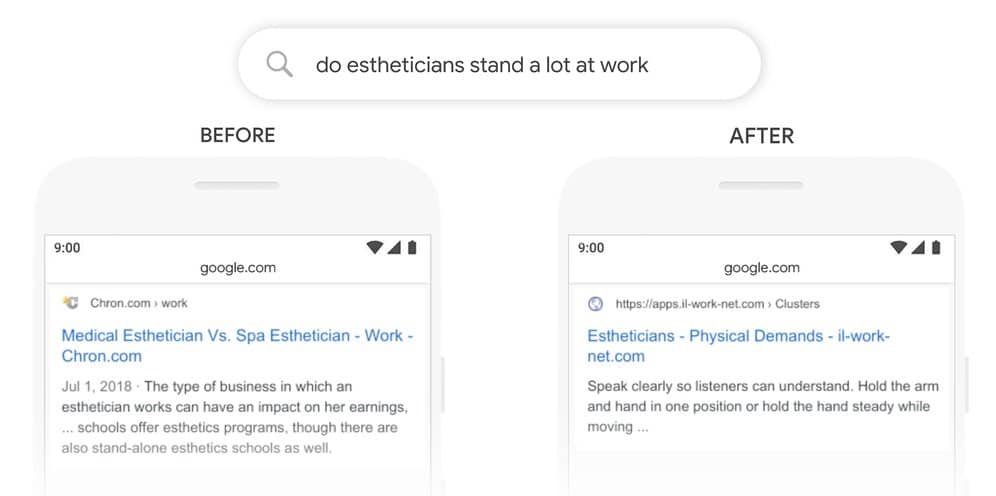

Esempio 2

In questo secondo caso, Google capisce che “stand” significa “stare in piedi”, mentre prima l’algoritmo lo interpretava come “stand-alone” (travisando il significato della query):

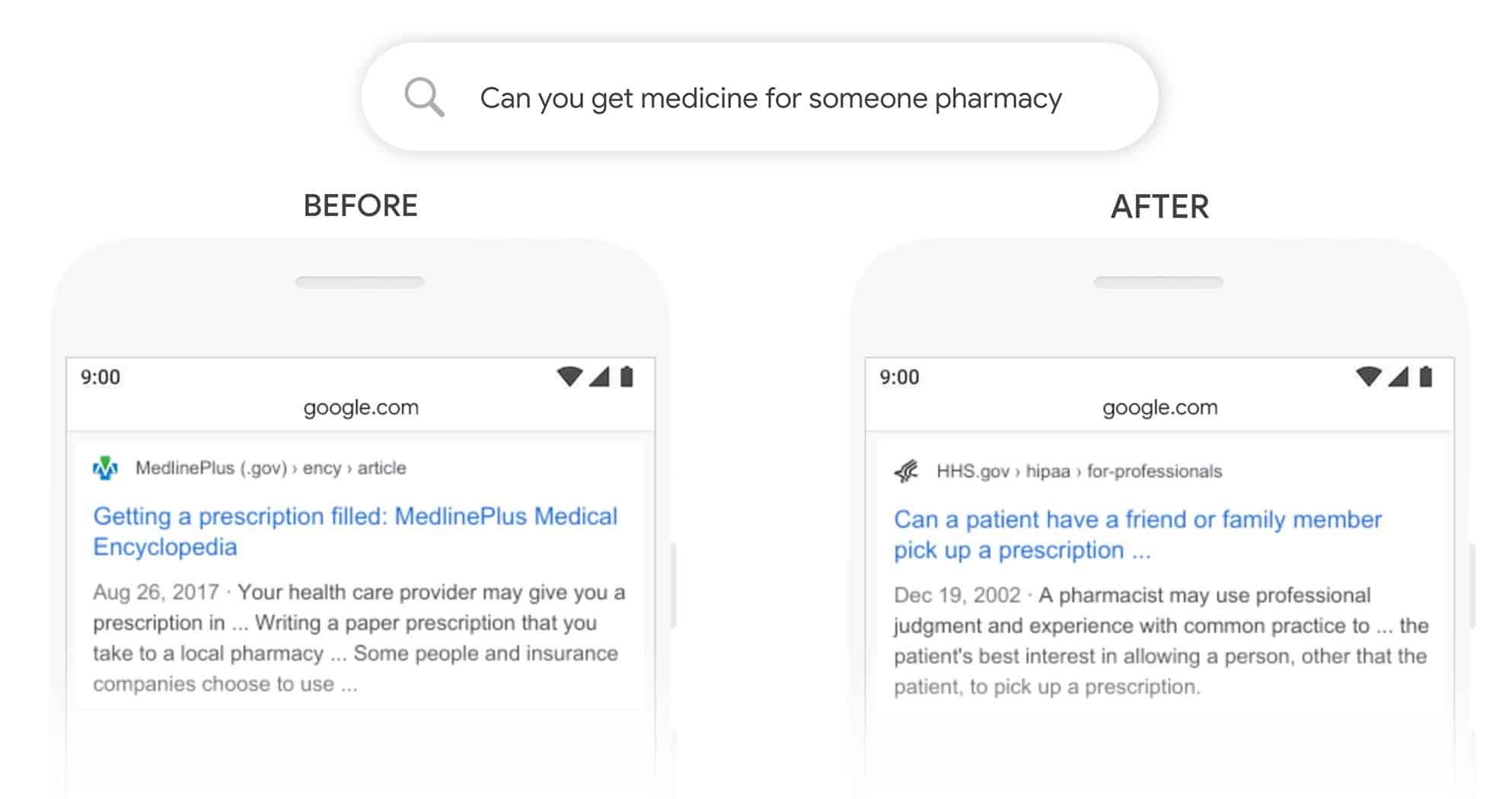

Esempio 3

Ecco un altro esempio di risultato di ricerca: “Puoi ritirare un medicinale per qualcun altro in farmacia?. Con il modello BERT, i risultati sono più basati sul contesto, BERT Google comprende l’importanza della parola “qualcun altro”, fornendo così come risposta i siti che spiegano come ritirare medicinali per un’altra persona mentre il vecchio algoritmo non avrebbe fornito una risposta accurata.

Conclusione

Il nuovo Google BERT è uno degli aggiornamenti più significativi degli ultimi anni. Poiché questo aggiornamento è focalizzato sul riconoscimento dell’intento di ricerca, non bisogna preoccuparsi di eventuali penalizzazioni ne di eventuali ottimizzazioni da fare, ce lo dice direttamente il “portavoce” di Google, Danny Sullivan:

“Non c’è nulla da ottimizzare per BERT, né qualcosa che dovresti ripensare. I fondamentali del premiare ottimi contenuti, per noi, rimangono gli stessi.”

BERT non cambia i fondamentali di ciò che Google dice da tempo, ovvero scrivere contenuti principalmente per gli utenti.

Comprendere il linguaggio naturale è una sfida complessa e continua per Google che riconosce, anche con BERT, potrebbe non ottenere un risultato accurato al 100%.

Tieni d’occhio i risultati della tua ricerca e facci sapere cosa vedi con questo nuovo aggiornamento!